Un agente AI non è un chatbot “più evoluto”. Non è un prompt con qualche funzione in più.

Un agente è un sistema orchestrato che:

- interpreta un obiettivo

- pianifica step intermedi

- utilizza strumenti esterni

- mantiene memoria

- opera entro vincoli

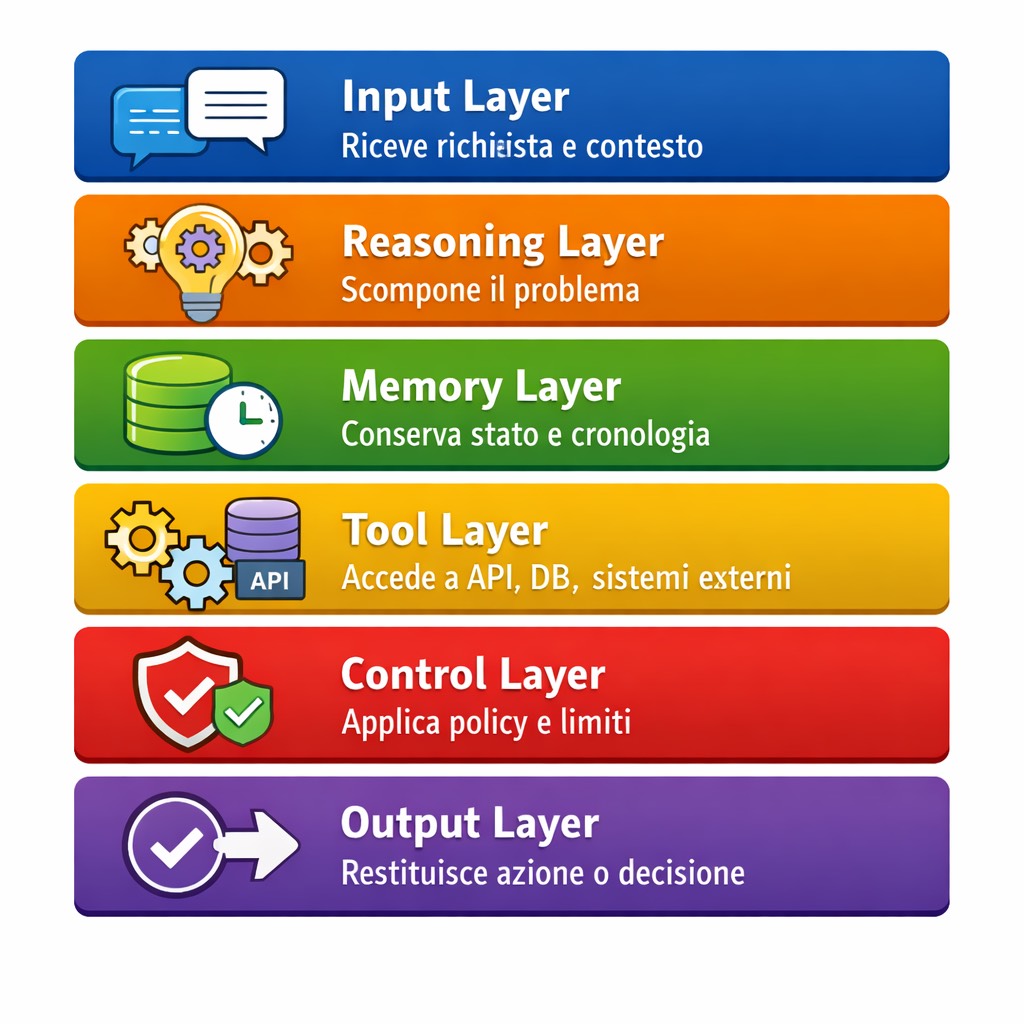

Tecnicamente, un agente serio ha almeno sei layer:

- Input layer – riceve richiesta e contesto

- Reasoning layer – scompone il problema

- Memory layer – conserva stato e cronologia

- Tool layer – accede a API, DB, sistemi esterni

- Control layer – applica policy e limiti

- Output layer – restituisce azione o decisione

Senza control layer non è un agente. È un LLM con accesso pericoloso agli strumenti.

La differenza è architetturale: un LLM genera testo. Un agente interagisce con infrastruttura.

E qui cambia tutto.

Dove gli agenti sono una cattiva idea

L’errore più comune è pensare: “Se può decidere, lasciamolo decidere.” No. Ci sono contesti in cui l’autonomia è una pessima scelta.

Autonomia sui sistemi core

ERP, contabilità, inventario, pricing dinamico, gestione cassa. Se un agente sbaglia una chiamata API o interpreta male un intent, non produce una risposta imprecisa. Produce un danno operativo.

Una modifica automatica ai prezzi. Un aggiornamento massivo errato. Un’azione irreversibile su database di produzione. Il problema non è l’intelligenza. È l’irrevocabilità dell’azione.

Agente “strategico”

Un agente che “decide la strategia aziendale” è marketing.

La strategia richiede:

- contesto politico

- visione temporale

- responsabilità

- trade-off non formalizzabili

Un modello può proporre opzioni ma non può assumersi conseguenze.

Infatti, se deleghi la direzione a un sistema che non è giuridicamente responsabile, stai creando un buco di governance.

Il ruolo delle simulazioni: autonomia controllata prima dell’azione reale

Prima dell’autonomia serve la simulazione.

Se un agente opera su sistemi core, non deve agire direttamente. Deve prima replicare lo scenario in un ambiente isolato, eseguire le stesse chiamate API su dati shadow, generare l’impatto previsto e produrre un report comparativo.

In pratica:

- modifica prezzi → simulazione su storico 12 mesi

- aggiornamento inventario → verifica collisioni e vincoli contabili

- nuova strategia revenue → backtesting su stagionalità reale

- automazione contabile → controllo su casi edge e anomalie fiscali

La simulazione trasforma l’agente da esecutore a motore di scenario.

Questo è il passaggio chiave.

Un agente che agisce senza simulare è un rischio operativo.

Un agente che simula prima di agire è uno strumento decisionale.

Nel caso dell’“agente strategico”, il suo ruolo corretto non è decidere.

È produrre scenari:

- Scenario A → +8% margine, -12% occupazione

- Scenario B → +5% occupazione, -3% prezzo medio

- Scenario C → rischio reputazionale alto

L’essere umano decide. L’agente calcola conseguenze.

La simulazione è il layer che chiude il buco di governance.

Perché introduce:

- previsione

- tracciabilità

- confronto tra alternative

- responsabilità esplicita

L’autonomia reale nei sistemi core non nasce dall’azione diretta. Nasce dalla capacità di prevedere prima di toccare la produzione.

Senza simulazione, l’agente è un acceleratore di errori. Con simulazione, diventa un amplificatore di consapevolezza.

Accesso diretto al database

È l’errore architetturale più pericoloso.

LLM → Database diretto

Sembra semplice. È suicida. Un agente deve passare da:

- Tool gateway

- Policy engine

- Logging

- Validazione output

Accesso diretto significa:

- nessun isolamento multi-tenant

- nessun controllo semantico

- nessun audit strutturato

In un SaaS come il tuo, con tenant hospitality separati, questo equivale a rischio di leakage tra clienti. Non è un problema tecnico. È legale.

Perché “Agente che decide strategie” è una fantasia pericolosa

L’idea seduce perché promette delega cognitiva totale. “Lasciamo decidere al sistema.”

Ma un agente:

- non ha “skin in the game”

- non ha esposizione patrimoniale

- non subisce conseguenze

- non ha reputazione da proteggere

Può ottimizzare una metrica locale distruggendo valore sistemico.

Esempio concreto.

Un agente revenue ottimizza occupazione → abbassa prezzi aggressivamente → aumenta booking → distrugge posizionamento premium → riduce LTV → danneggia brand.

Ha migliorato la metrica. Ha peggiorato il business.

La strategia è un problema multi-variabile con componenti non misurabili. Un agente può assistere. Non sostituire.

Quando leggi “AI che decide la tua strategia”, traduci correttamente: “AI che ottimizza un indicatore che abbiamo scelto male.”

Autonomia senza accountability = rischio legale

Qui la conversazione smette di essere tecnica. Diventa giuridica.

Se un agente:

- modifica prezzi

- rifiuta clienti

- altera priorità

- genera comunicazioni automatiche

chi è responsabile?

Il modello?

Il fornitore API?

Il CTO?

L’amministratore?

La risposta legale è semplice: la responsabilità è dell’azienda che ha attivato il sistema.

Nel contesto europeo, tra AI Act, GDPR e responsabilità civile, questo non è un tema teorico.

È governance.

Realtà vs Marketing

Il marketing vende: “Agenti autonomi che lavorano per te.”

La realtà è:

- Sistemi orchestrati con limiti rigidi

- Autonomia condizionata

- Controllo centrale

- Logging continuo

Un agente utile non è quello che decide tutto. È quello che opera dentro confini progettati.

Se non puoi spegnerlo in modo granulare, non è architettura. È imprudenza.

Posizionamento corretto

Un agente serio in un SaaS hospitality (ad esempio) dovrebbe:

- proporre azioni

- simulare scenari

- preparare esecuzioni

- richiedere conferma per azioni critiche

- operare in sandbox quando possibile

Il vero vantaggio competitivo non è “far decidere l’agente”. È progettare il perimetro in cui può agire. E quello non è marketing. È architettura.