Introduzione

Molti imprenditori oggi dicono: “Abbiamo messo l’AI nel sito.”

No.

Hai aggiunto un layer conversazionale.

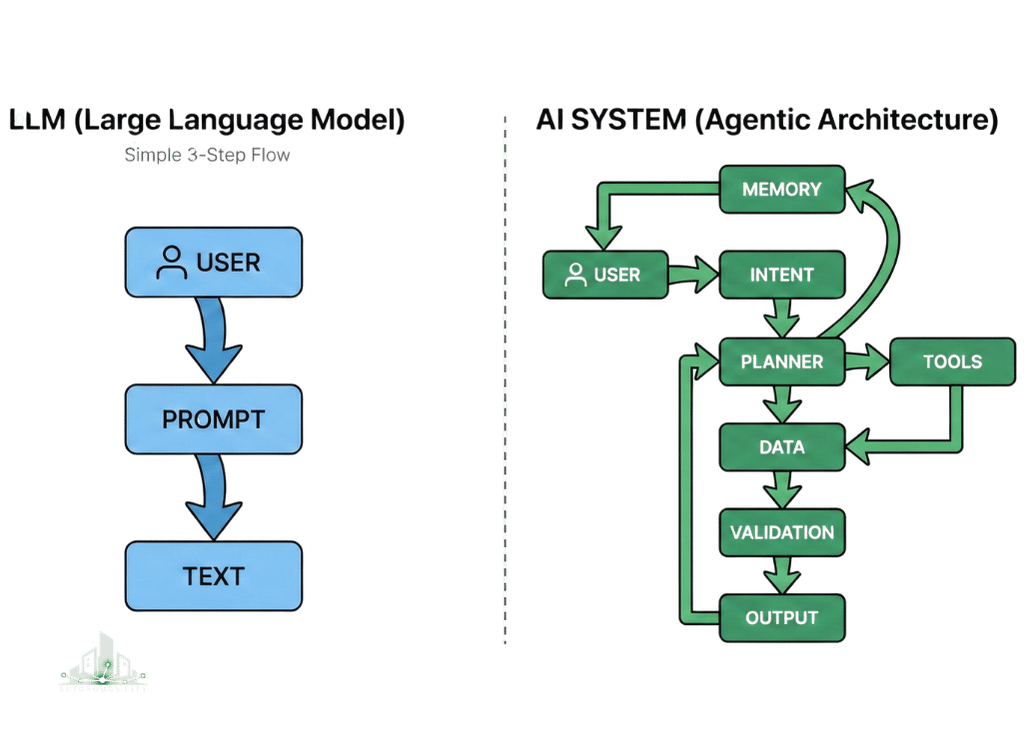

Un LLM genera testo. Un sistema AI prende decisioni integrate nei tuoi processi.

La differenza non è semantica. È economica.

Questo articolo non parla di prompt. Parla di architettura, controllo, memoria, orchestrazione e vantaggio competitivo reale.

Se l’AI non impatta costi, margini o tempi operativi, non è un sistema. È un esperimento.

Questo è il perimetro mentale.

Non stiamo entrando nell’era dell’intelligenza artificiale.

Quella fase è già finita.

Siamo nella fase in cui vince chi costruisce sistemi.

I modelli sono diventati accessibili. Le API sono standardizzate. Il costo computazionale scende.

Il vero differenziale non è più il modello. È l’architettura che gli costruisci intorno.

In questa serie di “AI Systems Foundations” non parlo di prompt. Non parlo di tool alla moda, Ma di infrastruttura, controllo, memoria, orchestrazione e vantaggio competitivo reale.

Ogni articolo aggiunge un layer. Alla fine non avrai capito cos’è l’AI.

Avrai capito come si costruisce un sistema che crea margine.

Cos’è davvero

Definizione

Un LLM è un motore generativo. Un Sistema AI è un’infrastruttura decisionale integrata con dati, strumenti e controllo. Fine.

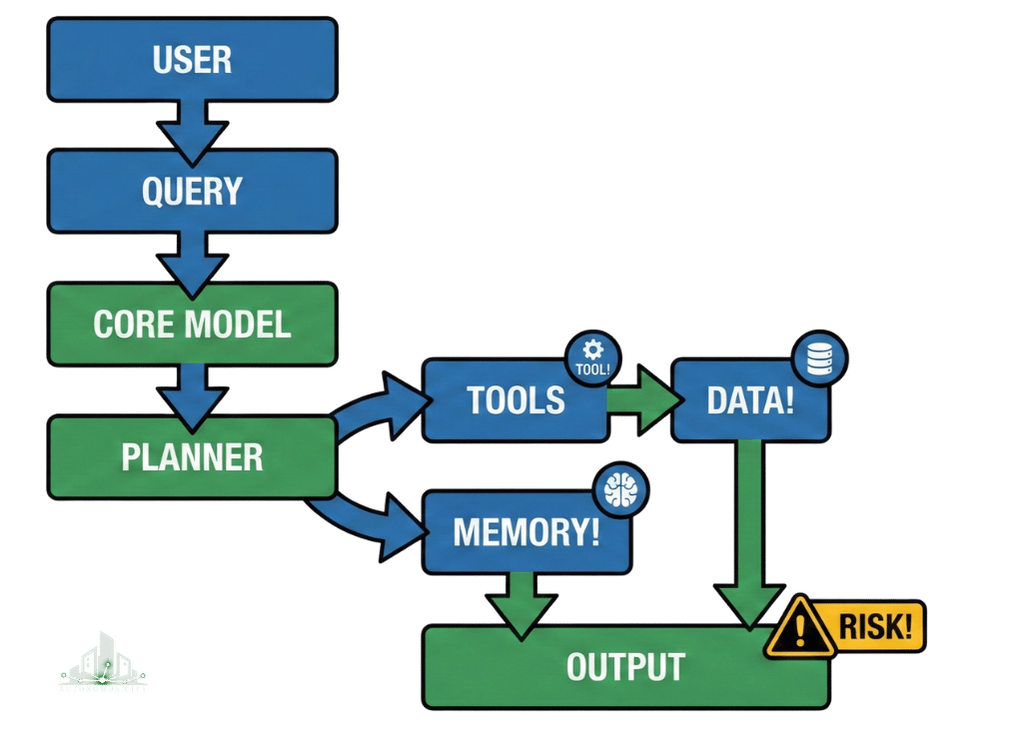

Componenti architetturali

- Input Layer: Riceve richiesta utente o evento di sistema (form, API, trigger).

- Reasoning Layer: LLM + logica di interpretazione + decomposizione task.

- Memory Layer: Persistente o temporanea. Contesto storico, stato utente, eventi passati.

- Tool Layer: Accesso controllato a API interne, Database, ERP / CRM, Servizi esterni

- Control / Orchestration Layer: (Gestisce): Sequenza chiamate, Validazioni, Fallback, Regole di sicurezza

- Output Layer: Risposta strutturata, azione eseguita o aggiornamento stato.

Differenza rispetto alla versione semplificata

LLM ≠ Sistema AI, infatti un LLM:

- Genera testo

- Non conosce il tuo database

- Non valida azioni

- Non ha responsabilità operativa

Un Sistema AI:

- Interroga dati reali

- Decide quali strumenti usare

- Aggiorna stati

- Riduce tempo uomo

- Riduce errori

Integrare ChatGPT in un sito ≠ creare vantaggio competitivo.

Come funziona realmente (Flow operativo)

- Riceve richiesta: “Quante camere sono disponibili questo weekend?”

- Interpreta intent: → Query su disponibilità

- Scompone task:

→ Recupero disponibilità

→ Applicazione regole prezzo

→ Verifica stato camere - Seleziona strumenti

Planner decide:- Tool Gateway

- API PMS

- Database disponibilità

- Recupera dati

→ Query PostgreSQL

→ Rientro nel contesto LLM - Valida output

→ Controllo formato

→ Controllo coerenza - Aggiorna memoria

→ Log richiesta

→ Aggiorna contesto sessione

Micro esempio tecnico:

Planner → Tool Gateway

Tool Gateway → API disponibilità

API → DB

DB → JSON strutturato

JSON → LLM

LLM → Risposta validata

Questa è architettura.

Non prompt engineering.

Trade-off e limiti

Questa è la parte che quasi nessuno scrive.

⚠️ Rischi architetturali

- Accesso diretto al DB (errore grave)

- Mancanza isolamento multi-tenant

- Tool senza validazione schema

- Logging insufficiente

- Assenza di controllo versioni modello

⚠️ Limiti tecnici

- Latency multi-step

- Costo token in chaining

- Drift di memoria

- Hallucination in tool chaining

- Debug complesso

Un sistema AI non controllato diventa un rischio operativo.

Quando usarlo (Decision Framework)

❌ Non usarlo se:

- Task single-step

- FAQ statiche

- Nessuna integrazione esterna

- Nessun impatto economico

Un LLM semplice basta.

✅ Usalo se:

- Task multi-step

- Necessità contesto persistente

- Integrazione API / DB

- Decisioni operative

- Riduzione tempo uomo

- Riduzione errori ripetitivi

Decision rule:

Se non tocca margine o tempo operativo → non è priorità.

Implicazioni nel tempo

- Tool Gateway diventerà layer standard.

- I SaaS verticali verranno affiancati da AI sidecar.

- I database diventeranno AI-queryable nativamente.

- L’orchestrazione varrà più del modello.

- Le aziende senza layer AI perderanno margine operativo.

Il vantaggio competitivo non sarà nel prompt migliore. Sarà nel sistema più integrato.

Business Impact reale

Se vuoi misurare il valore, misura questo:

Riduzione costo uomo: Automazione task ripetitivi → meno ore operative.

Riduzione errori: Controllo strutturato → meno errori manuali.

Tempo risposta: Supporto immediato → aumento conversioni.

Scalabilità: Stessa struttura → più clienti → nessun aumento lineare costi.

Un LLM genera testo. Un sistema AI genera margine.

TL;DR

- Integrare ChatGPT non crea vantaggio competitivo

- Un LLM genera testo, non decisioni

- Il vantaggio nasce dall’orchestrazione

- Tool Gateway è obbligatorio

- La memoria è moltiplicatore strategico

- L’AI vale solo se impatta costi, margini o tempi